Artikel zur Veröffentlichung in den Proceedings von NeurIPS2022 akzeptiert

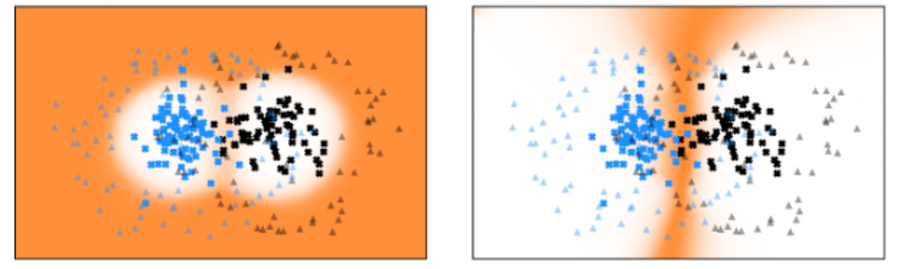

Wir stellen einen Ansatz zur Quantifizierung sowohl der Aleatorik als auch der Epistemik für tiefe neuronale Netzwerke in der Bildklassifizierung vor, basierend auf generativen adversarialen Netzwerken (GANs). Während die meisten Arbeiten in der Literatur, die GANs zur Generierung von Out-of-Distribution (OoD)-Beispielen nutzen, sich nur auf die Evaluierung der OoD-Erkennung konzentrieren, präsentieren wir einen GAN-basierten Ansatz, um einen Klassifikator zu lernen, der korrekte Unsicherheiten für OoD-Beispiele sowie für falsch positive Ergebnisse (FPs) liefert. Anstatt alle Daten der In-Distribution mit von GAN generierten OoD-Beispielen abzuschirmen, wie es der aktuelle Stand der Technik ist, schirmen wir jede Klasse separat mit von einem conditional GAN generierten Out-of-Class-Beispielen ab und ergänzen dies durch einen One-vs-All Bildklassifikator. In unseren Experimenten, insbesondere auf CIFAR10, CIFAR100 und Tiny ImageNet, verbessern wir die OoD-Erkennung und die FP-Erkennungsleistung von GAN-basierten Klassifikatoren, die aktuell den Stand der Technik darstellen. Darüber hinaus stellen wir fest, dass die generierten GAN-Beispiele den Kalibrierungsfehler unseres Klassifikators nicht signifikant beeinflussen und zu einer signifikanten Steigerung der Modellgenauigkeit führen. Die Vorabversion des Artikels kann hier gefunden werden: arxiv.org/abs/2201.13279